注意力机制有哪些 主要原理是什么

时间:2025-03-30 23:57 阅读数:7959人阅读

*** 次数:1999998 已用完,请联系开发者***

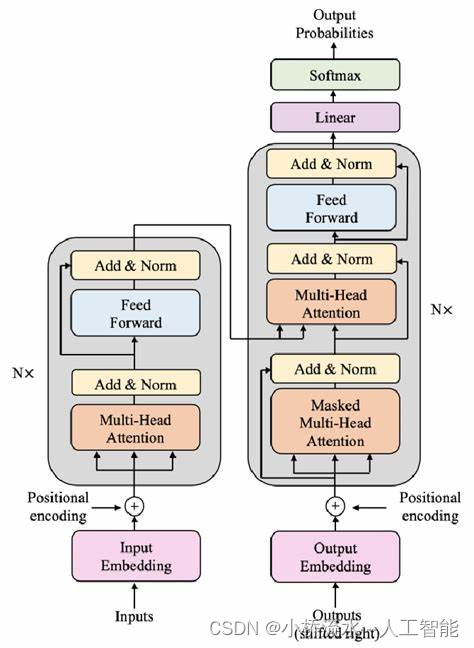

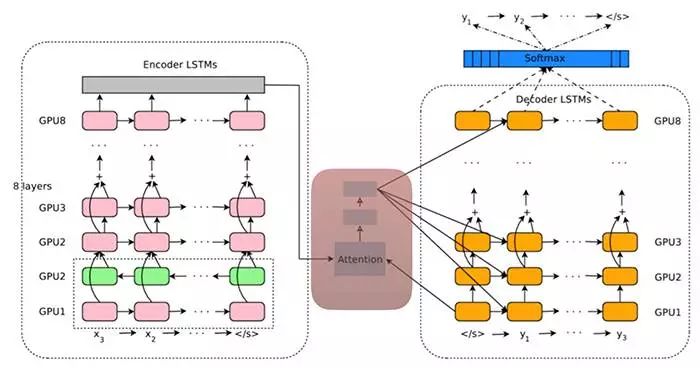

AI绘画中,Transformer的“自注意力机制”有什么作用?自注意力机制就是让模型在处理每个单词时,都能关注到句子中的其他单词,并赋予它们不同的权重。这样一来,模型就能更好地捕捉文本中的语义关系和依赖关系。 让我们以一个简单的例子来解释自注意力机制的原理。假设我们有一个句子:“猫喜欢玩耍,它总是在院子里追逐蝴蝶。”...

╯^╰

算法人生(20):从“自注意力机制”看“个人精力怎么管”自注意力机制起到的作用主要是将序列中的每个位置都视为 Query、Key 和 Value,并利用它们之间的相互作用来计算每个位置的注意力分数,然... 集中处理:自注意力机制通过集中注意力于少数关键元素,提高了信息处理的效率。个人精力管理也可以遵循类似的原理,尽量减少多任务并行处...

ˇ0ˇ

陈丹琦团队揭Transformer内部原理:从构建初代聊天机器人入手好家伙!为了揭秘Transformer内部工作原理,陈丹琦团队直接复现——第一个经典聊天机器人ELIZA。ELIZA编写于20世纪60年代,主要用于心理... 他们在研究中发现:Transformer模型倾向于使用注意力机制来识别和复制序列中的特定模式,而非严格按照词的位置来复制即使没有特别为记忆...

evo加速器部分文章、数据、图片来自互联网,一切版权均归源网站或源作者所有。

如果侵犯了你的权益请来信告知删除。邮箱:xxxxxxx@qq.com

上一篇:注意力机制有哪些 主要原理是什么

下一篇:加速器梯子永久免费